7종 신규 칩 양산 시작…훈련·추론·스토리지·네트워킹 아우르는 통합 플랫폼 공개

엔비디아가 미국 새너제이에서 열린 ‘GTC 2026’에서 차세대 AI 인프라 플랫폼 ‘베라 루빈(Vera Rubin)’을 공개하고, 에이전틱 AI 시대를 겨냥한 7종의 신규 칩 양산을 시작했다고 발표했다.

엔비디아에 따르면 베라 루빈 플랫폼은 베라 CPU, 루빈 GPU, NVLink 6 스위치, 커넥트X-9 슈퍼NIC, 블루필드-4 DPU, 스펙트럼-6 이더넷 스위치, 새롭게 통합된 그록 3 LPU를 포함한다. 이들 칩은 하나의 거대한 AI 슈퍼컴퓨터처럼 작동하도록 설계됐으며, 대규모 사전·사후 훈련과 테스트 시점 확장, 실시간 에이전틱 추론까지 AI 전 단계를 지원하는 것이 특징이다.

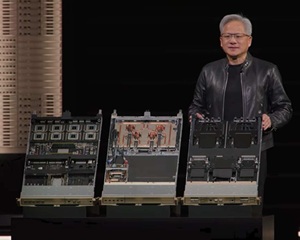

엔비디아 창립자 겸 CEO 젠슨 황은 “베라 루빈은 세대를 뛰어넘는 도약”이라며, “7개의 혁신적인 칩, 5개의 랙, 하나의 거대한 슈퍼컴퓨터가 AI의 모든 단계를 지원하도록 구축됐다”고 밝혔다. 이어, “이제 에이전틱 AI의 전환점이 도래했으며, 베라 루빈이 역사상 가장 큰 인프라 구축을 본격화하고 있다”고 말했다.

앤트로픽 공동 창립자 겸 CEO 다리오 아모데이는 “복잡한 추론과 에이전틱 워크플로우, 미션 크리티컬 의사결정을 위해서는 이에 걸맞은 인프라가 필요하다”며, “베라 루빈 플랫폼은 이러한 요구를 충족할 수 있는 컴퓨팅과 네트워킹, 시스템 설계 역량을 제공한다”고 밝혔다.

오픈AI CEO 샘 올트먼도 “엔비디아 인프라는 AI의 지평을 넓히는 기반”이라며, “베라 루빈을 통해 더 강력한 모델과 에이전트를 대규모로 구동하고, 더 빠르고 안정적인 시스템을 제공할 수 있을 것”이라고 말했다.

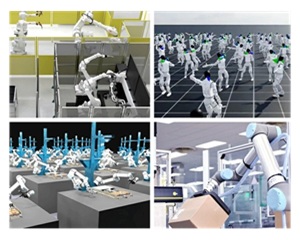

AI 인프라는 이제 개별 칩과 독립형 서버 중심에서 벗어나, 완전 통합형 랙 규모 시스템과 POD 규모 배치, AI 팩토리, 소버린 AI로 빠르게 진화하고 있다. 엔비디아는 이러한 변화가 성능을 끌어올리는 동시에 스타트업부터 공공기관, 대기업에 이르기까지 다양한 산업군의 비용 효율성과 접근성을 개선한다고 설명했다.

베라 루빈 플랫폼은 컴퓨팅과 네트워킹, 스토리지 전반의 공동 설계를 기반으로 하며, 80개 이상의 엔비디아 MGX 생태계 파트너가 이를 지원한다. 엔비디아는 이를 통해 여러 랙이 하나의 통합 시스템처럼 작동하는 POD 규모 AI 인프라를 구현할 수 있다고 강조했다.

핵심 제품 가운데 하나인 ‘베라 루빈 NVL72’ 랙은 72개의 루빈 GPU와 36개의 베라 CPU, 커넥트X-9 슈퍼NIC, 블루필드-4 DPU를 통합한 구조다. 엔비디아는 이 시스템이 블랙웰 플랫폼 대비 4분의 1 수준의 GPU 수로 대규모 MoE(전문가 혼합) 모델을 훈련시키고, 토큰당 비용은 10분의 1 수준으로 유지하면서 와트당 추론 처리량을 최대 10배까지 높일 수 있다고 설명했다.

‘베라 CPU 랙’은 강화학습과 에이전틱 AI 워크로드를 지원하기 위한 CPU 기반 인프라다. 256개의 베라 CPU를 통합한 고밀도 액체 냉각 구조를 갖추고 있으며, 엔비디아는 이를 통해 세계 최고 수준의 단일 스레드 성능과 함께 대규모 에이전틱 AI에 필요한 효율적인 처리 환경을 제공한다고 밝혔다.

‘그록 3 LPX 랙’도 함께 공개됐다. 엔비디아는 이 제품이 에이전틱 시스템의 저지연·대규모 컨텍스트 요구를 충족하도록 설계됐으며, 베라 루빈과 결합할 경우 메가와트당 최대 35배 높은 추론 처리량과 1조 파라미터 모델 기준 최대 10배 높은 수익 기회를 제공한다고 설명했다. LPX 랙은 256개의 LPU 프로세서와 128GB 온칩 SRAM, 초당 640TB의 확장형 대역폭을 제공하며, 올해 하반기 출시될 예정이다.

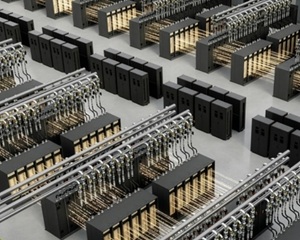

스토리지 측면에서는 ‘블루필드-4 STX’ 랙 규모 시스템이 소개됐다. 이 제품은 GPU 메모리를 POD 전반으로 확장하는 AI 네이티브 스토리지 인프라로, 대규모 언어 모델과 에이전틱 AI 워크플로우에서 생성되는 대규모 키-값 캐시 데이터를 저장하고 검색하는 데 최적화됐다. 엔비디아는 도카 메모스(DOCA Memos) 프레임워크를 통해 추론 처리량을 최대 5배까지 높이고, 멀티턴 상호작용 속도와 인프라 활용도를 향상시킬 수 있다고 밝혔다.

‘스펙트럼-6 SPX 이더넷 랙’은 AI 팩토리 전반의 동서 트래픽을 가속하도록 설계됐다. 엔비디아는 이 시스템이 대규모 환경에서 저지연·고처리량의 랙 간 연결을 제공하며, 광학 모듈이 통합된 스펙트럼-X 이더넷 포토닉스를 통해 기존 플러그형 트랜시버 대비 최대 5배 높은 광 전력 효율과 10배 높은 복원력을 제공한다는 설명이다.

엔비디아는 복원력과 에너지 효율성 개선을 위한 소프트웨어와 설계 체계도 함께 공개했다. 200개 이상의 데이터센터 인프라 파트너와 함께 발표한 DSX 플랫폼에는 동적 전력 프로비저닝을 통해 고정된 전력 환경에서 최대 30% 더 많은 AI 인프라 구축을 지원하는 ‘DSX 맥스-Q’가 포함됐다. 또한 ‘DSX 플렉스’는 AI 팩토리를 전력망 유연성을 갖춘 에셋으로 전환해 유휴 전력을 활용할 수 있도록 지원한다.

이와 함께 공개된 ‘베라 루빈 DSX AI 팩토리 레퍼런스 디자인’은 컴퓨팅, 네트워킹, 스토리지, 전력, 냉각을 긴밀하게 통합해 와트당 토큰 수와 전체 처리량을 극대화하고, 초기 프로덕션까지 걸리는 시간을 단축하는 공동 설계 AI 인프라 청사진을 제시한다.

베라 루빈 기반 제품은 올해 하반기부터 주요 클라우드 제공업체와 파트너사를 통해 공급될 예정이다. 여기에는 AWS, 구글 클라우드, 마이크로소프트 애저, 오라클 클라우드 인프라스트럭처를 비롯해 코어위브, 크루소, 람다, 네비우스, 엔스케일, 투게더 AI 등이 포함된다.

또한 시스코, 델 테크놀로지스, HPE, 레노버, 슈퍼마이크로를 포함한 글로벌 시스템 제조업체들이 베라 루빈 기반 서버를 공급할 예정이며, 앤트로픽, 메타, 미스트랄 AI, 오픈AI 등 주요 AI 연구소와 모델 개발사들도 이 플랫폼을 활용해 더 크고 성능이 뛰어난 모델을 훈련시키고, 보다 긴 컨텍스트와 멀티모달 시스템을 낮은 지연과 비용으로 제공할 계획이라고 엔비디아는 밝혔다.

<저작권자(c)스마트앤컴퍼니. 무단전재-재배포금지>