블랙웰 울트라서 처리량 최대 3배…글로벌 기업 생태계 확대

엔비디아(NVIDIA)가 NVFP4 정밀도를 기반으로 AI 훈련과 추론 성능을 크게 향상시킬 수 있다고 밝혔다. NVFP4는 높은 정확도를 유지하면서 처리량과 에너지 효율을 동시에 개선해 차세대 AI 워크로드 최적화를 지원하는 기술이다.

최신 AI 모델의 규모와 복잡성이 증가하면서 훈련과 추론에 필요한 컴퓨팅 성능도 급격히 확대되고 있다. 이에 따라 기존 무어의 법칙만으로는 수요를 감당하기 어려운 상황이다. 엔비디아는 이러한 한계를 극복하기 위해 칩과 소프트웨어 전반을 아우르는 공동 설계(codesign) 전략을 채택하고 있으며, 이를 통해 AI 팩토리의 성능과 효율을 세대별로 끌어올리고 있다고 밝혔다.

저정밀 연산은 성능과 전력 효율 향상의 핵심 요소다. NVFP4는 4비트 부동소수점 정밀도를 기반으로, 고정밀 포맷에 준하는 정확도를 유지하면서도 연산 밀도와 효율을 높인다. 이 기술은 엔비디아 블랙웰(Blackwell) 아키텍처부터 도입됐다.

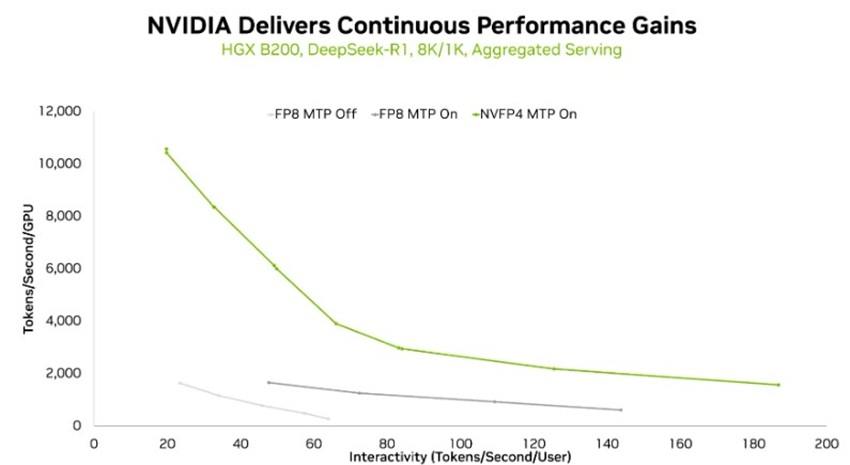

블랙웰 울트라 GPU는 NVFP4 기준 최대 15페타플롭스의 처리량을 제공하며, 동일 GPU에서 FP8 대비 최대 3배 높은 성능을 구현한다. 추론 영역에서는 6,710억 매개변수 규모의 전문가 혼합(MoE) 모델 ‘딥시크-R1(DeepSeek-R1)’에서 FP8 대비 토큰 처리량이 향상된 것으로 나타났다.

훈련 분야에서도 성과가 확인됐다. 최신 MLPerf Training 벤치마크에서 512개의 블랙웰 울트라 GPU로 구성된 엔비디아 GB300 NVL72 시스템은 NVFP4 정밀도를 활용해 라마 3.1 405B 사전훈련을 64.6분 만에 완료했다. 이는 FP8 기반 블랙웰 GPU 시스템 대비 최대 1.9배 빠른 기록이다고.

향후 출시될 엔비디아 루빈(Rubin) 플랫폼은 NVFP4 기반 성능을 한층 강화할 전망이다. 루빈은 NVFP4 기준 훈련 연산에서 35페타플롭스, 추론에서는 50페타플롭스 성능을 제공해 블랙웰 대비 각각 3.5배, 5배 향상된 수준을 목표로 한다고 업체 측은 설명했다.

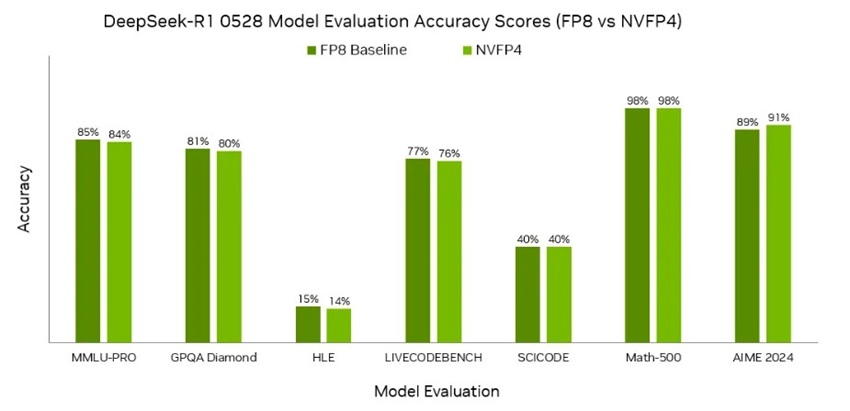

정확도 측면에서도 NVFP4는 업계 기준을 충족했다. 엔비디아는 MLPerf 훈련과 추론 부문에서 NVFP4 기반 모델로 모든 비공개 테스트 항목을 통과했다고 밝혔다. 딥시크-R1, 라마 3.1 8B·405B, 라마 2 70B 등 주요 LLM 모델에서도 벤치마크 요구 정확도를 유지했다.

생태계 확장도 가속화되고 있다. 엔비디아 모델 옵티마이저, LLM 컴프레서, torch.ao 등 라이브러리를 통해 고정밀 모델을 NVFP4로 양자화할 수 있으며, TensorRT-LLM, vLLM, SGLang 등 주요 추론 프레임워크도 NVFP4 실행을 지원한다. 허깅페이스에는 라마 3.3 70B, 딥시크-R1, Qwen3-235B-A22B 등 NVFP4 버전 모델이 공개돼 있다.

글로벌 기업들도 NVFP4 도입에 나섰다. 블랙 포레스트 랩스는 블랙웰 기반 NVFP4 최적화를 통해 단일 B200 GPU에서 최대 6.3배 속도 향상을 달성했다고 밝혔다. 래디컬 뉴메릭스는 과학 모델 학습에 NVFP4를 적용해 긴 컨텍스트와 멀티모달 학습 효율을 개선했다고 설명했다. 코그니션과 레드햇 역시 대규모 강화학습과 LLM 확장 환경에서 지연 시간과 처리량 개선 효과를 확인했다.

엔비디아는 트랜스포머 엔진 라이브러리와 메가트론-브릿지(Megatron-Bridge)를 통해 NVFP4 기반 훈련 레시피를 지원하고 있으며, 향후 더 복잡하고 대규모 모델을 빠르고 효율적으로 훈련할 수 있도록 생태계를 확대해 나갈 계획이다.

<저작권자(c)스마트앤컴퍼니. 무단전재-재배포금지>