KAIST, 일반 영상 하나로 1인칭 시점 영상 생성... 3차원 공간 이해 기반으로 1개의 3인칭 영상만으로 변환

만약 영화 다크나잇을 보면서 화면 속 조커를 바라보는 것이 아니라, 내가 조커가 되어 고담시를 직접 바라본다면 어떨까. 관객의 시선이 아닌 등장인물의 눈으로 세상을 경험하는 영상 기술이 현실이 되고 있다. KAIST 연구진이 일반 영상만으로도 사용자가 직접 보는 시점의 영상을 생성하는 새로운 인공지능 모델을 개발했다.

KAIST(총장 이광형)는 김재철AI대학원 주재걸 석좌교수 연구팀이 관찰자 시점의 영상만을 활용해 영상 속 인물이 실제로 보고 있었을 장면을 정밀하게 생성하는 인공지능 모델 ‘에고엑스(EgoX)’를 개발했다고 2월 23일 밝혔다.

< KAIST 주재걸 교수팀 사진 >

최근 증강현실(AR), 가상현실(VR), AI 로봇 기술이 빠르게 발전하면서 ‘내가 직접 보는 장면’을 그대로 담은 1인칭 시점 영상(Egocentric video)의 중요성이 커지고 있다. 그러나 고품질의 1인칭 영상을 얻기 위해서는 사용자가 고가의 액션캠이나 스마트 글래스를 직접 착용해야 하는 한계가 있었다. 또한 이미 촬영된 일반 영상(제3자 시점, Exocentric video)을 1인칭 시점으로 자연스럽게 변환하는 데에도 기술적 제약이 존재했다.

이번 기술은 단순히 화면을 회전시키는 수준을 넘어, 인물의 위치와 자세, 주변 공간의 3차원(3D) 구조를 종합적으로 이해한 뒤 이를 기반으로 1인칭 시점 영상을 재구성한다는 점이 특징이다.

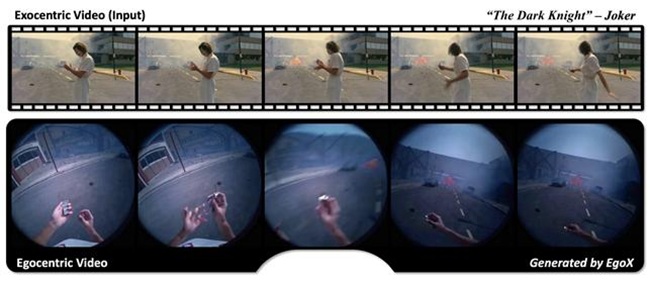

< 3인칭 시점을 1인칭으로 변환하는 EgoX기술(AI생성이미지) >

기존 기술은 정지 이미지만 변환하거나 4대 이상의 카메라 영상이 필요한 경우가 많았다. 또한 빛의 방향이나 움직임이 복잡한 동영상에서는 화면이 어색해지는 문제가 있었다. 반면 EgoX는 단 하나의 3인칭 시점 영상만으로도 고품질의 1인칭 영상을 생성할 수 있다. 연구팀은 특히 인물의 머리 움직임과 실제 시야 사이의 상관관계를 정밀하게 모델링함으로써, 고개를 돌릴 때 시야가 자연스럽게 전환되는 모습까지 사실적으로 구현하는 데 성공했다.

이 기술은 특정 환경에 국한되지 않고 요리, 운동, 작업 등 다양한 일상 상황에서도 안정적인 성능을 보였다. 이를 통해 별도의 웨어러블 장치를 착용하지 않고도 기존에 축적된 영상으로부터 고품질의 1인칭 시점 데이터를 확보할 수 있는 새로운 가능성을 열었다는 평가를 받고 있다.

EgoX는 향후 다양한 산업 분야에 상당한 파급력을 미칠 것으로 기대된다. AR·VR 및 메타버스 분야에서는 일반 영상을 사용자가 직접 체험하는 듯한 몰입형 콘텐츠로 전환해 사용자 경험을 극대화할 수 있다.

< 3인칭 시점 영상을 1인칭 시점 영상으로 변환한 예시 >

또한 로봇이 사람의 행동을 보고 학습하는 모방 학습(Imitation Learning)의 핵심 데이터로 활용될 수 있어 로봇과 AI 학습 분야에도 기여할 것으로 전망된다. 스포츠 중계나 브이로그를 선수나 주인공의 시점으로 전환하는 등 새로운 형태의 영상 서비스도 가능해질 것으로 기대된다.

주재걸 석좌교수는 “이번 연구는 단순한 영상 변환 기술을 넘어, 인공지능이 사람의 ‘시야’와 ‘공간 이해’를 학습해 재구성했다는 점에서 의미가 크다”며, “앞으로는 기존에 촬영된 영상만으로도 누구나 몰입형 콘텐츠를 제작하고 경험할 수 있는 환경이 열릴 것으로 기대한다”고 말했다. 이어 “KAIST는 생성형 AI 기반 비디오 기술 분야에서 세계적 경쟁력을 확보해 나갈 것”이라고 덧붙였다.

이번 연구는 강태웅, 김기남 KAIST 박사과정, 김도현 서울대 학부연구생이 제 1저자로 참여했으며, 논문은 2025년 12월 9일 arXiv에 선공개되어 미국 NVIDIA 및 Meta 등의 빅테크들을 비롯한 AI 산업 및 학계의 큰 주목을 받았으며, 2026년 6월 3일 미국 콜로라도에서 열리는 국제 학술대회인 The IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)에 공식 발표될 예정이다.

<저작권자(c)스마트앤컴퍼니. 무단전재-재배포금지>